Per dare alle donne accademiche e ad altre persone focalizzate sull'IA il tempo che meritano - e che è in ritardo - sotto i riflettori, TechCrunch ha pubblicato una serie di interviste incentrate su donne straordinarie che hanno contribuito alla rivoluzione dell'IA. Stiamo pubblicando queste interviste durante l'anno mentre il boom dell'IA continua, mettendo in evidenza lavori chiave spesso poco riconosciuti. Leggi più profili qui.

Chinasa T. Okolo è un membro del'Brookings Instutition nel programma di Studi sulla Governance del Centro di Innovazione Tecnologica. Prima di questo, ha fatto parte del comitato etico e di impatto sociale che ha aiutato a sviluppare la Strategia Nazionale sull'Intelligenza Artificiale della Nigeria e ha lavorato come consulente di politica ed etica sull'IA per varie organizzazioni, tra cui l'Agenzia per lo Sviluppo dell'Unione Africana e l'Istituto Quebecois di Intelligenza Artificiale. Ha recentemente conseguito un dottorato in informatica presso l'Università di Cornell, dove ha studiato come l'IA influisce sul Sud del mondo.

Brevemente, come hai iniziato nella AI? Cosa ti ha attratto in questo campo?

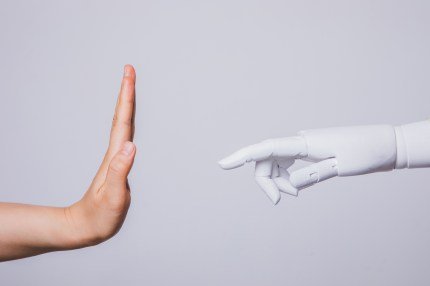

Inizialmente sono passata all'AI perché ho visto come le tecniche computazionali potessero far avanzare la ricerca biomedica e democratizzare l'accesso alle cure sanitarie per le comunità emarginate. Durante il mio ultimo anno di laurea [al Pomona College], ho iniziato a fare ricerca con un professore di interazione uomo-computer, il che mi ha esposto alle sfide del pregiudizio nell'IA. Durante il mio dottorato, mi sono interessata a capire come queste questioni avrebbero influenzato le persone nel Sud del mondo, che rappresentano la maggior parte della popolazione mondiale e spesso sono escluse e sottorappresentate nello sviluppo dell'IA.

Qual è il lavoro di cui sei più orgoglioso (nel campo dell'IA)?

Sono estremamente orgogliosa del mio lavoro con l'Unione Africana (UA) nello sviluppo della Strategia Continentale UA-AI per l'Africa, che mira ad aiutare gli Stati membri dell'UA a prepararsi per l'adozione, lo sviluppo e la governance responsabile dell'IA. La stesura della strategia ha richiesto oltre 1,5 anni ed è stata pubblicata alla fine di febbraio 2024. Attualmente è in un periodo di feedback aperto con l'obiettivo di essere formalmente adottata dagli Stati membri dell'UA all'inizio del 2025.

Come primo figlio di Nigeriani-Americani cresciuta a Kansas City, MO, e non sono uscita dagli Stati Uniti fino a quando non ho studiato all'estero durante l'università, ho sempre puntato a centrare la mia carriera in Africa. Coinvolgermi in un lavoro così significativo così presto nella mia carriera mi rende entusiasta di perseguire opportunità simili per contribuire a plasmare una governance dell'IA inclusiva e globale.

Come affronti le sfide dell'industria tecnologica a predominanza maschile e, per estensione, dell'industria dell'IA a predominanza maschile?

Trovare una comunità con persone che condividono i miei valori è stato essenziale per navigare nelle industrie tecnologiche e dell'IA dominate dagli uomini.

Sono stata fortunata a vedere molti progressi nell'IA responsabile e importanti ricerche che espongono i danni causati dall'IA guidate da studiosi donne nere come Timnit Gebru, Safiya Noble, Abeba Birhane, Ruha Benjamin, Joy Buolamwini e Deb Raji, molte delle quali ho potuto conoscere negli ultimi anni. Vedere il loro leadership mi ha motivato a continuare il mio lavoro in questo campo e mi ha mostrato il valore del andare 'controcorrente' per avere un impatto significativo.

Quale consiglio daresti alle donne che desiderano entrare nel campo dell'IA?

Non lasciarti intimidire dalla mancanza di un background tecnico. Il campo dell'IA è multidimensionale e ha bisogno delle competenze di varie discipline. La mia ricerca è stata fortemente influenzata da sociologi, antropologi, scienziati cognitivi, filosofi e altri all'interno delle discipline umanistiche e delle scienze sociali.

Quali sono alcuni dei problemi più urgenti che l'IA deve affrontare mentre evolve?

Uno dei problemi più importanti sarà migliorare la rappresentazione equa delle culture non-occidentali nei modelli di linguaggio e multimodali rilevanti. La grande maggioranza dei modelli di IA viene addestrata in inglese e su dati che rappresentano principalmente contesti occidentali, escludendo preziose prospettive dalla maggioranza del mondo.

Inoltre, la corsa verso la costruzione di modelli sempre più grandi porterà a un maggiore esaurimento delle risorse naturali e a maggiori impatti sul cambiamento climatico, che già colpiscono in modo sproporzionato i paesi del Sud del mondo.

Quali sono alcuni problemi di cui gli utenti di AI dovrebbero essere consapevoli?

Un numero significativo di strumenti e sistemi di IA messi in esercizio pubblico esagerano le proprie capacità e semplicemente non funzionano. Molte delle attività che le persone cercano di svolgere con l'AI potrebbero probabilmente essere risolte attraverso algoritmi più semplici o automazione di base.

Inoltre, l'IA generativa ha la capacità di esacerbare i danni osservati dai precedenti strumenti di IA. Per anni abbiamo visto come questi strumenti mostrano pregiudizi e portano a decisioni dannose per le comunità vulnerabili, il che probabilmente aumenterà man mano che l'IA generativa crescerà in scala e diffusione. Tuttavia, fornire alle persone le conoscenze per capire i limiti dell'IA può contribuire a migliorare l'adozione e l'uso responsabile di questi strumenti. Migliorare la conoscenza dell'IA e dei dati nel pubblico in generale diventerà fondamentale man mano che gli strumenti di IA vengono rapidamente integrati nella società.

Qual è il modo migliore per costruire responsabilmente l'IA?

Il modo migliore per costruire responsabilmente l'IA è essere critici rispetto ai casi d'uso voluti e non voluti di questi strumenti. Le persone che costruiscono sistemi di IA hanno la responsabilità di opporsi all'uso dell'IA per scenari dannosi in caso di guerra e polizia e dovrebbero cercare consulenza esterna se l'IA è appropriata per altri casi d'uso che potrebbero essere mirati. Dato che l'IA è spesso un amplificatore delle disuguaglianze sociali esistenti, è anche imperativo che sviluppatori e ricercatori siano cauti nel modo in cui costruiscono e curano i dataset utilizzati per addestrare i modelli di IA.

Come possono gli investitori spingere per un'IA responsabile?

Molti sostengono che l'interesse crescente dei VC nel 'cashing out' sull'attuale ondata di AI abbia accelerato la diffusione del 'olio di serpente AI', coniato da Arvind Narayanan e Sayash Kapoor. Concordo con questo sentimento e credo che gli investitori debbano assumere posizioni di leadership, insieme agli accademici, agli stakeholder della società civile e ai membri del settore, per promuovere lo sviluppo responsabile dell'IA. Essendo io stessa un investitore angelo, ho visto molti strumenti di AI dubbi sul mercato. Gli investitori dovrebbero anche investire nell'esperienza in materia di IA per valutare le aziende e richiedere audit esterni degli strumenti dimostrati nei pitch deck.

C'è qualcos'altro che desideri aggiungere?

Questa continua "estate dell'IA" ha portato a una proliferazione degli "esperti di AI" che spesso distolgono da importanti conversazioni sui rischi e danni attuali dell'IA e forniscono informazioni fuorvianti sulle capacità degli strumenti abilitati dall'IA. Incoraggio coloro interessati a educarsi sull'IA a essere critici su queste voci e cercare fonti autorevoli da cui imparare.